Nicht besonders clever

Anfang November hat die Enquete-Kommission »Künstliche Intelligenz – Gesellschaftliche Verantwortung und wirtschaftliche, soziale und ökologische Potenziale« des Deutschen Bundestags ihren Abschlussbericht vorgelegt. Nach zweijähriger Arbeit resümiert sie, dass die technologische Entwicklung der Künstlichen Intelligenz (KI) mit einem Wertewandel einhergehe und »nicht per se schlecht« sei. Sie bedürfe allerdings einer demokratischen Gestaltung »auf der Basis einer Übereinkunft über gutes und gerechtes Leben für heute und für zukünftige Generationen«, wie es in einer Zusammenfassung des Berichts heißt.

Fast alle Bundestagsfraktionen stimmten dem Abschlussbericht zu, nur die Linkspartei enthielt sich. »Es fehlen Vorschläge, wie die KI-Entwicklung durch ein anderes europäisches Konzept gesellschaftlicher und demokratischer Werte grundiert werden kann. Stattdessen wird die eigene Entwicklung lediglich in Konkurrenz zu den USA und China definiert. Wir halten den Fokus auf reine Standortlogik für falsch«, begründet Petra Sitte ihre Enthaltung in einer Pressemitteilung. Sie ist stellvertretende Fraktionsvorsitzende und ordentliches Mitglied in der Enquete-Kommission.

Künstliche Intelligenzen sind immer nur so präzise, so ethisch und so transparent, wie ihre Programmierung und ihre Datengrundlage es gestatten.

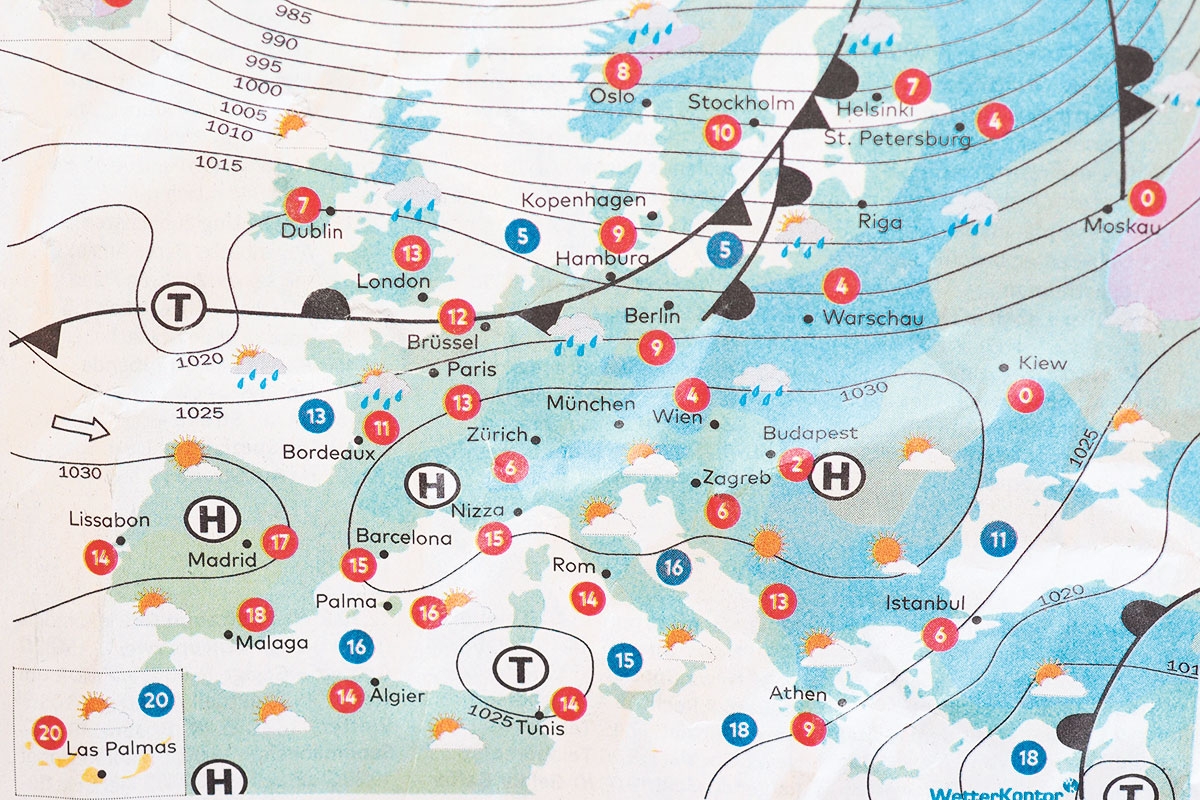

Künstliche Intelligenzen produzieren mittlerweile Hunderttausende von Artikeln, die jede Woche in verschiedenen Medien auf der ganzen Welt veröffentlicht werden, vor allem über Wetter, Sport oder Börsenkurse. Es sind Bereiche, für die zahlreiche, gut strukturierte Daten vorliegen. Eine KI kann einfache Textbausteine generieren, um diese Daten zusammenfügen.

Die Projektgruppe »KI und Medien« der Enquete-Kommission legte eine Bestandsaufnahme vor, in der es sowohl um die Produktion von Medien als auch um die Distribution von Inhalten geht. Darin heißt es: »KI-gesteuerte Empfehlungs- und Filtersysteme bieten neue Möglichkeiten für Bürgerinnen und Bürger, sich an politischen Diskussionen zu beteiligen, bergen jedoch auch Risiken hinsichtlich stark personalisierter Informationsräume, die vornehmlich auf das gezielte Platzieren verhaltensbasierter Werbung ausgerichtet sind.« Damit gemeint sind Newsfeeds auf Plattformen wie Facebook oder priorisierte Suchergebnisse etwa bei Google.

Der Abschlussbericht fordert politische Maßnahmen, um unabhängigen Journalismus und eine pluralistische Öffentlichkeit zu fördern. Dafür müssten die Kompetenzen von Bürgerinnen und Bürgern im Umgang mit digitalen Nachrichten dauerhaft gestärkt werden. Um die Medienvielfalt zu erhalten, schlägt die Projektgruppe eine Anpassung des Kartellrechts und gegebenenfalls die Einführung einer Digitalsteuer vor. Wie diese aussehen soll, wird allerdings nicht ausgeführt.

Die SPD hatte zudem einen »Algorithmen-TÜV« gefordert, damit niemand durch Software diskriminiert werde, etwa bei automatisierten Entscheidungen über Kreditwürdigkeit oder bei der Bewertung von Bewerbungen. Solch eine Institution könnte für Transparenz von Algorithmen sorgen, die Sicherheit von KI-gesteuerten Prozessen gewährleisten und vor Ungleichbehandlung schützen. Doch darauf konnten sich die Mitglieder der Kommission nicht einigen. Konkrete Maßnahmen konnte keine der Projektgruppen entwickeln.

Medien wenden Algorithmen bereits vielfach an. Bei der US-amerikanischen Nachrichten- und Bildagentur Bloomberg wird mittlerweile ein Drittel der Nachrichten und Texte von Programmen mit KI erstellt. Auch die Nachrichtenagentur AP publiziert computergenerierte Finanzberichte und Informationsgraphiken. Die Gemeinschaftsredaktion von Stuttgarter Zeitung und Stuttgarter Nachrichten hat einen Feinstaubradar entwickelt, der auf der Grundlage von Messwerten automatisiert tagesaktuell Feinstaubberichte generiert und in Echtzeit visualisiert. Die CDU-nahe Konrad-Adenauer-Stiftung zeichnete dieses Projekt 2017 mit einem Preis für Lokaljournalismus in der Kategorie Datenjournalismus. Die Jury lobte besonders die Verbindung von automatisierter, anschaulicher Datenverarbeitung und der journalistischen Darstellung und Einordnung von Hintergründen »bei einem politisch brisanten Thema«. Während in den USA solche maschinengenerierten Texte oft gekennzeichnet sind, ist das in Deutschland meist nicht der Fall.

Der Journalist und Buchautor Christoph Drösser lebt in San Francisco und beschäftigt sich seit einigen Jahren mit dem Einfluss von Algorithmen auf die Medien. Der Einsatz von KI im Journalismus kann seiner Meinung nach durchaus Vorteile haben: »Der größte Teil journalistischer Arbeit besteht ja im Recherchieren. Man kann KI sicherlich als Werkzeug benutzen, um Daten zu suchen und relevante Informationen zu finden. Der eigentliche Schreibvorgang benötigt dann nicht mehr so viel Zeit«, sagt Drösser der Jungle World.

Die Enquete-Kommission sieht auch Gefahren. »Produktions- und Distributionsmethoden wandeln sich in und um die Medien durch KI stark. Die wirtschaftlichen Auswirkungen sind bis heute nicht exakt auf KI-Effekte rückführbar und statistisch erfassbar, wie die ökonomischen Rahmendaten veranschaulichen. Wohl aber ist abschätzbar, dass sich die Anforderungen an die Arbeitsplätze in den Medien signifikant verändern werden, gegebenenfalls werden auch Arbeitsplätze wegfallen durch Automatisierungsprozesse und Kostendruck. Auch ist offenkundig, dass sich der Wettbewerb und somit in einzelnen Segmenten die Medienkonzentration durch den Einfluss von KI signifikant verschärfen«, heißt es im Bericht.

Neben solchen Bedenken, welche Folgen der Einsatz von KI für journalistische Arbeitsplätze haben wird, gibt es Debatten über die Transparenz der Programme und über die ethische Bewertung der Technologie. Bevor die US-amerikanische Washington Post Artikel auf ihrer Website publiziert, lässt sie eine KI abschätzen, wie oft diese wohl angeklickt werden. »Das kann natürlich schon bedenklich sein«, meint auch Drösser. Denn eigentlich sollte der Nachrichtenwert über die Veröffentlichung eines Textes entscheiden und nicht, wie häufig er gelesen wird.

Vor allem soziale Medien und die dort geteilten Artikel haben in den vergangenen Jahren gesellschaftliche Konflikte verschärft, weil sie dazu tendieren, geschlossene Meinungsmilieus zu erzeugen. Hier beeinflussen die Algorithmen beispielsweise, welche Informationen und Beiträge Leser und Leserinnen vorzugsweise zu sehen bekommen, in welcher Reihenfolge Suchergebnisse erscheinen und welche Werbeanzeigen jemandem angezeigt werden.

Wenn redaktionelle Entscheidungen zu stark von wirtschaftlichen Interessen bestimmt werden, stellt dies immer auch eine Gefahr für die Pressefreiheit dar. »Wenn eine KI entscheidet, was ich lese, und meine Zeitung aussieht wie ein Facebook-Feed, finde ich das ethisch bedenklich«, beschreibt Drösser das Problem. Dabei sei entscheidend, welche Interessen jeweils mit welcher Priorisierung verbunden sind: »Die KI selbst hat keine Interessen, sie arbeitet nach einer bestimmten Metrik. Nicht die Technik ist also das Problem.« In seinem Buch »Wenn die Dinge mit uns reden«schreibt Drösser: »Dass KI-Systeme oft gesellschaftliche Vorurteile und Missstände perpetuieren, ist inzwischen in vielen Studien nachgewiesen worden, und auch die Sprachtechnologien machen da keine Ausnahmen.«

Künstliche Intelligenzen wie Schreibprogramme sind immer nur so immer nur so präzise, so ethisch und so transparent, wie ihre Programmierung und ihre Datengrundlage es gestatten. Ohne menschliches Zutun wird Journalismus auch künftig nicht zu machen sein, weil nur bestimmte Sparten und Formate automatisiert werden können. Im Unterschied zur Wettermeldung kann eine Maschine keinen klugen Kommentar und keine fesselnde Reportage schreiben.

Suche beendet

Suche beendet